Principais vantagens

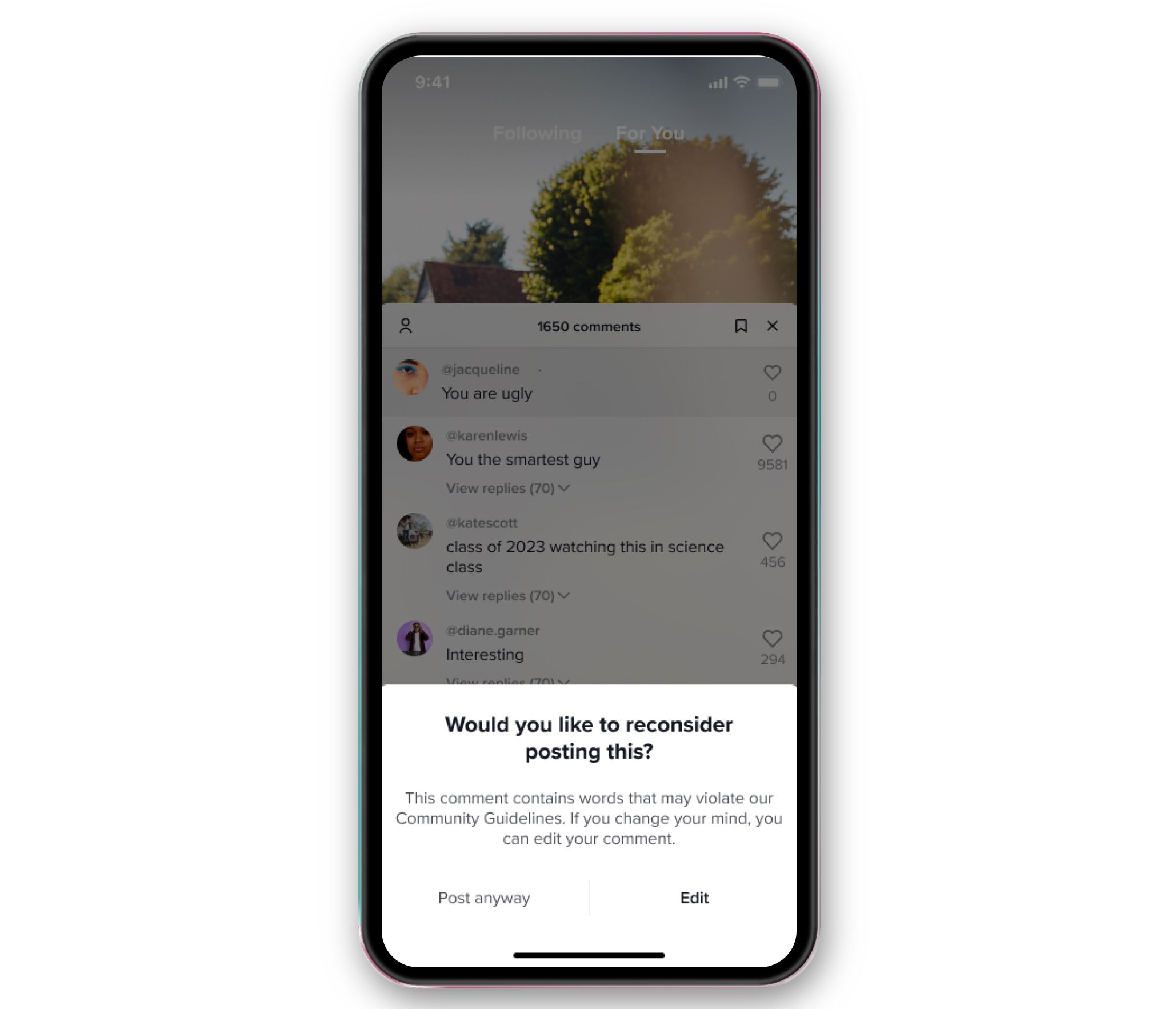

- O TikTok agora avisará os usuários antes de enviarem um comentário que possa violar as Diretrizes da comunidade do aplicativo.

- Embora útil, muitos veem isso como um pequeno passo para parar o bullying e o ódio online.

- Em última análise, o TikTok e outros sites de mídia social precisam encontrar novas soluções fora da moderação automatizada para realmente avançar.

A moderação online é um dos problemas mais desafiadores que a mídia social enfrenta no momento, mas os especialistas dizem que a solução não é simplesmente adicionar mais regras. O TikTok adicionou recentemente um novo recurso que avisará os usuários antes de permitir que enviem o que considera um comentário odioso ou que quebra as regras. A mudança é uma tentativa de ajudar a conter o ódio e intimidação online que se espalhou por várias redes de mídia social, incluindo o popular aplicativo de compartilhamento de vídeo. Infelizmente, embora os sites tenham uma boa relação com esses recursos, eles não abordam o problema mais significativo que está por baixo da superfície. “O principal problema com tanto [online moderation] é que não existe um tamanho único para todos. Não existe uma boa solução que funcione para todos “, Catie Osborn, uma TikToker que recentemente se viu lidando com um banimento permanente, disse à Lifewire em uma ligação.

Encontrando Clareza

Osborn, conhecido como “catieosaurus” no TikTok, tem mais de 400.000 seguidores no site de compartilhamento de vídeos. Em seus vídeos, ela enfoca o bem-estar sexual, como é viver com TDAH e outros tópicos neurodivergentes. No fim de semana, no entanto, ela viu todo o seu trabalho em risco quando TikTok baniu sua conta por “quebrar as diretrizes da comunidade”, sem qualquer contexto adicional de quais regras ela poderia ter violado. É essa falta de esclarecimento que se tornou tão perturbadora para muitos usuários. Como sites de mídia social como o TikTok e o Twitter trazem tantos relatórios, grande parte do processo é automatizado. “Quando você está falando sobre centenas de milhões de usuários, não existe uma solução perfeita.” Isso significa que os sistemas são implementados para acionar proibições temporárias, dependendo do número de relatórios que um determinado conteúdo gera. Por exemplo, Osborn nos disse que se várias pessoas denunciarem um vídeo ao vivo do TikToker, elas imediatamente banem esse usuário de ir ao vivo por pelo menos 24 horas. “Há uma falta de clareza sobre o que funciona e o que não funciona”, explicou Osborn. De acordo com Osborn, o aplicativo teve um aumento considerável no número de usuários criadores de relatórios em massa porque eles não gostam da cor de sua pele, sua sexualidade e muito mais. Essa possibilidade e a falta de esclarecimento do TikTok sobre o que o usuário fez de errado é uma grande parte da frustração, diz ela. “Como podemos saber o que fizemos de errado se você não nos contar”, ela perguntou. “Estou mais do que disposto a dizer que errei. Mas, se você não me contar como eu errei, não posso consertar.” Osborn não é o único que se viu confuso com a proibição. Vários usuários se voltaram para o feed do Twitter do TikTok para encontrar respostas sobre seus banimentos, com muitos tweets recebendo a mesma resposta para apelar do banimento de dentro do aplicativo.

Sem entender por que foram banidos, os usuários podem ficar ainda mais frustrados ao tentar descobrir o que fazer a seguir.

Fomentando Novas Soluções

Embora recursos como solicitações de comentários possam afetar positivamente a comunidade, alguns não os veem como soluções de longo prazo. “Esse recurso provavelmente só influenciará os indivíduos que realmente desejam evitar soar mal intencionalmente”, disse Cody Nault, um engenheiro de software que compartilha sua codificação no TikTok, à Lifewire por e-mail. “Infelizmente, parece que muito do ódio que se espalha na plataforma tem a intenção de ser duro.”

Nault explicou como as pessoas continuam a usar o recurso Stitch do TikTok – que permite juntar partes de outro vídeo com o seu – para chamar a atenção e ridicularizar os criadores. Ele atribui muito disso ao sucesso que o conteúdo odioso pode ter nas redes sociais e disse que adoraria ver o TikTok promovendo criadores mais positivos. Para outros como Osborn, o problema não é a falta de recursos de relatórios. É como os sites lidam com esses relatórios. A falta de comunicação e os sistemas de relatório facilmente explorados são grandes problemas que precisam ser resolvidos, mas ela não é ingênua. “Quando você está falando sobre centenas de milhões de usuários, não existe uma solução perfeita”, disse Osborn. Ela acrescentou que, embora sua conta tenha sido restabelecida, muitos criadores não tiveram a mesma sorte. “Não acho que exista uma solução única para todos. Mas, quando o padrão está se tornando, centenas de criadores estão tendo suas contas banidas – e repetidamente – por não fazerem nada de errado, algo tem que mudar.”